2026.06.08 アカマイ・テクノロジーズ合同会社とパートナーシップ契約を締結〜最新GPUとAI技術による伴走型技術支援を開始〜

株式会社EQUESは、最新鋭GPUを提供するアカマイ・テクノロジーズ合同会社(本社:東京都中央区、代表:日隈寛和、以下「Akamai」)と、同社の顧客を高度なAI技術で支援するパートナーシップ契約を締結したことをお知らせいたします。 ■ 協業の背景と目的 現在、多くの企業が生成AIやRAG(検索拡張生成)の実用化を模索していますが、高度なAIモデルの社会実装には、機密データを守るセキュアな環境と、パフォーマンスを支える低遅延なインフラが不可欠です。 本連携により、Akamaiが世界最大級のスケールで提供する最新鋭GPU「RTX PRO 6000 Blackwell」と、当社の高度なAI技術を組み合わせることで、社内ドキュメントなどを活用するRAGシステムにおいて、高速かつセキュアなエージェント環境の構築を実現します。 ■ EQUESによる「伴走型技術開発」の提供 EQUESは、Akamai Inference Cloudを利用するお客様や、AIの導入を目指す企業様に対し、要件定義から運用までを一気通貫でサポートする「伴走型技術開発」を提供します。企業ごとの目的に応じたAIモデルの仮説検証(PoC)を強力に支援し、お客様の課題解決に寄り添います。 ■ 代表コメント アカマイ・テクノロジーズ合同会社 職務執行者社長 日隈 寛和 氏 「この度、東京大学松尾研究室発の優れたAI技術と実績を持つEQUES様をパートナーとしてお迎えできることを大変嬉しく思います。現在、多くの企業が生成AIやRAGの実用化を模索していますが、高度なモデルの社会実装には、それを支える安全かつ低遅延なインフラが不可欠です。EQUES様とのパートナーシップによって、お客様は機密データを安全に保ちながら、圧倒的なパフォーマンスでAIエージェントを活用できるようになります。両社の強みを活かし、日本企業のAIトランスフォーメーションを強力に加速させてまいります。」 株式会社EQUES 代表取締役 岸 尚希 「この度、世界的なエッジおよびクラウドプラットフォームを提供するアカマイ・テクノロジーズ様と協業させていただけることを大変嬉しく思います。EQUESは、最先端のディープラーニング技術やLLMを活用したアルゴリズム開発と、その社会実装に強みを持っています。同社の高性能なGPUインフラを最大限に活用した、次世代のAIエージェントプラットフォームの構築を本格化させてまいります。本協業における伴走型技術開発を通して、最先端技術の研究に基づく社会実装をさらに加速させてまいります。」 本件に関する詳細につきましては、以下のボタンからお問い合わせください。 お問い合わせはこちら EQUESは今後も、「最先端の機械学習技術と実務現場を結ぶ架け橋に」というミッションのもと、社会の発展を加速させるAIの社会実装に取り組んでまいります。

2026.06.01 【量子コンピューター】Quantinuum Symposiumポスターセッション登壇のお知らせ

Quantinuum社が6/2(火)に開催するイベント「Quantinuum June 2026 Symposium」のポスターセッションにおきまして、株式会社EQUES のメンバーが登壇し、量子アルゴリズムを用いた最新の研究成果について発表いたします。 発表内容の概要 発表タイトル: Simulating MDRO Gut Colonization Dynamics with XY-QAOA: Designing Commensal Communities against K.pneumoniae 背景と目的: 院内感染や敗血症の主要な原因であり、世界中で多剤耐性(MDRO)株が蔓延している肺炎桿菌(Klebsiella pneumoniae)対策をテーマとしています。本研究の目標は、腸内定着ダイナミクスを再現・予測するシミュレーションフレームワークを構築することです。 アプローチ: 肺炎桿菌が依存する栄養素を常在菌に消費させることで、肺炎桿菌を飢餓状態に追い込む「Nutrient Blocking」というアプローチを採用しています。その入力生成において、量子ネイティブな手法であるXY-QAOAを統合し、最適な5種の常在菌コンソーシアムを選択するモデルを構築しました。 シミュレーション結果: コンソーシアムを導入したすべてのバリアントにおいて、肺炎桿菌が閾値(0.5 OD)を下回り、排除されることが確認されました。この効果は、投与が遅れた場合(Day +3)や、50%の低栄養ストレス環境下でも維持される堅牢性を示しています。 イベント詳細 イベントの参加方法や詳細なスケジュールにつきましては、以下の特設ページよりご確認ください。 Quantinuum社 イベントページ: https://quantinuum.co.jp/n20260327/ 会場にて皆様とディスカッションできることを楽しみにしております。引き続き、株式会社EQUESの研究開発の取り組みにご期待ください。

2026.05.25 日本医療研究開発機構(AMED)向けAI基盤に関する検証業務(トライアルプロジェクト)を受託

この度、株式会社EQUESは、国立研究開発法人日本医療研究開発機構(以下「AMED」)が実施した公募入札「創薬支援を見据えた生成AIシステムの試行的構築及びコンサルティング業務」において、AMED内部利用を想定したAI基盤に関する検証業務(トライアルプロジェクト)を受託し、プロジェクトを開始したことをお知らせいたします。 プロジェクトの背景と目的 本プロジェクトは、AMEDの第3期中長期計画にて掲げる「出口志向の研究開発マネジメント」の業務効率化などの実現に向けた取り組みの一環です。 生成AIを活用し、これまでAMED内に蓄積された創薬ナレッジや事業に関する情報等を有効活用することで、優れた創薬シーズの実用化を加速させ、日本の創薬力向上に資することを目的としています。第一弾として、専門知と公募情報を統合したチャットボットを試行導入し、研究本部長やPM的役割を担う次世代AIを見据え、AMEDのシンクタンク機能強化を支援いたします。 プロジェクトの概要 今回の検証業務(トライアルプロジェクト)では、主に以下の項目を実施いたします。 生成AI技術の適用可能性の整理 内部利用における技術的・運用的課題の抽出 セキュリティ・ガバナンスへの適合性の確認 株式会社EQUESは、「最先端の機械学習技術をあやつり社会の発展を加速させる」というミッションのもと、引き続きお客様の課題に寄り添った伴走型の技術開発や、製薬業界の課題解決に貢献してまいります。 AI導入や実証実験(PoC)の実施などを検討中の場合は、右上のお問い合わせ窓口よりぜひご連絡ください。 ・ PR TIMES プレスリリース詳細: https://prtimes.jp/main/html/rd/p/000000027.000101360.html お問い合わせはこちら

Service

EQUESは、高い専門性による創出力を、現場への価値変換力とスピードによって、

シームレスに産業へとつなげることを強みとしています。

EQUESは多くの企業とパートナーシップを結んでいます。 ※一部抜粋

Example

AI×DX寺子屋|茨城県立竜ヶ崎第一高校・附属中学校で「未来の教室」を開催

2025.11.17

中高生が「AIエージェント」で地元企業の課題解決に挑む 株式会社EQUESは、2025年10月18日に茨城県立竜ヶ崎第一高等学校・附属中学校(以下、竜ヶ崎第一高校・附属中学校)で開催された「ホンモノのキャリア教育プログラム」において、「未来を拓くAI×人のチカラ」をテーマにした特別授業を実施しました。本授業は、生徒がAIの現代ビジネスにおける重要性や最先端技術「AIエージェント」について理解を深め、地元企業のリアルな課題解決に挑む、新しい形のAI×ビジネスワークショップとして展開されました。 開催の背景:学校の想いとEQUESの「AI×DX寺子屋」 今回の特別授業は、同校の太田垣校長先生から頂いた「次世代を生きる生徒たちに“ホンモノ”のキャリア教育を提供したい」というご相談がきっかけとなりました。 このご要望に対し、弊社が推進するAI相談サービス「AI×DX寺子屋」のカスタマイズプランを活用。「ビジネスにおけるAIエージェントの台頭」という未来を見据え、AIと“協働”するとはどういうことかを考える、未来創造型のAI×ビジネス授業として実施する運びとなりました。 また、地元企業の実際の課題を題材にすることで、生徒の柔軟な発想が企業に新たな視点をもたらすとともに、生徒自身の地元企業への理解と愛着をも深める、地域全体でのWin-Winな関係構築を目指しました。 【ご協力いただいた地元企業・研究機関様のご紹介(一部:掲載許可を頂いた企業様のみ)】 国立研究開発法人日本原子力研究開発機構 様 株式会社 常陽銀行 様 株式会社タナカ 様 高エネルギー加速器研究機構 様 一誠商事株式会社 様 授業概要:AIエージェントで未来のビジネスをデザインする 当日の授業は、講義とワークショップの二部構成で実施しました。 1. 講義:AIとビジネスの関係 授業前半では、当社スタッフが登壇。EQUESが手掛ける「伴走型技術開発」や「製薬AI事業」などの具体的なAIソリューション事例を紹介するとともに、「なぜ今、ビジネス環境にAIが必要なのか」、そして「AIエージェント」という最先端技術が未来をどう変えるかについて解説しました。AIが単なるツールではなく、ビジネスのあり方そのものを変革する力を持っていることを伝えました。 2. ワークショップ:AIエージェントを活用して地元企業の課題を解決する 後半は、3〜4人のグループに分かれ、「地元企業の課題を分解し、それを解決するAIエージェントを考える」というテーマで実践的なワークショップを実施。生徒たちはAIやPCツールを積極的に活用しながら活発に意見を交換しました。最終的には溢れたアイデアをワークシートにまとめ、教室に設置されたモニターを使って発表を行いました。 (↑写真:常陽銀行様のワークシートの例。生徒は、若者と高齢者など、世代や環境によってサービスを利用したくなる条件は大きく異なっているため、それぞれに合った施策が必要だと考え提案を行いました。) 授業の雰囲気:技術的な質問が飛び交う、ハイレベルな議論 初対面のグループが多い中、すぐに打ち解けて目標に向けた建設的な話し合いが始まり、和気藹々とした雰囲気ながらも白熱した議論が展開されていました。 生徒の皆さんからは沢山の新しい発想が提案され、「アイデアはたくさん出るが、どう企業のサービスと合致させていけばいいのか」などといった発展的な悩みの声が聞かれるなど、その想像力の豊かさには驚かされました。 また、講師陣に寄せられた質問は、「その技術は具体的にどうやって実現するのか?」「ビジネスとしての実現可能性は?」といった、技術的な側面や事業性にまで踏み込むハイレベルなものばかりでした。 (↑写真:講義中の雰囲気。生徒様は熱心に授業に耳を傾け、新しいAIエージェント技術の概要に興味津々でした。) 校長:太田垣先生のコメント 飛ぶ鳥を落とす勢いのAIビジネスから中高生のために貴重なお時間をいただき、心より感謝申し上げます。「AIエージェント」というリクエストに応え、単なる座学ではなく動きながら身に付けるワークショップ型の講座にまとめ上げていただいた情熱と使命感に敬意を表します。準備や進行についても教職員と緻密な調整を重ねていただき、参加した生徒・保護者にも大満足の質の高い講座を一緒に作り上げることができました。 私たち竜一は今後も時代の先頭を走る生徒たちを育てていきます。今後ともどうぞよろしくお願いいたします。 EQUESより:未来のイノベーターたちへの期待 今回、竜ヶ崎第一高校・附属中学校という非常に意欲的な生徒の皆さんとお会いでき、私たち自身も大きな刺激を受けました。 「AIエージェント」は、まだ社会に普及し始めたばかりの新しい技術です。それを中高生のうちからビジネスの視点で考え、具体的な実現可能性まで踏み込んで質問する生徒たちのポテンシャルに、深く感銘を受けています。 今回の授業が、生徒の皆さんが未来のイノベーターとして羽ばたくための一助となれば幸いです。EQUESは今後も、最先端のAI技術を社会に結ぶ架け橋となる活動を続けてまいります。 今回の授業を実現した「AI×DX寺子屋」について 「AI×DX寺子屋」は、東大生・東大出身者が7割を占めるEQUESのメンバーが、AIやDXに関する素朴な疑問や困りごとをチャットで回答し、お客様のAI活用やDX推進をサポートするサービスです。 AI専門家集団への相談し放題、AIツールの活用提案を特徴とする月額制の「プランA」のほか、今回のようなAI人材研修の実施、技術顧問、開発支援など、お客様の要望に応じて柔軟に内容を決定する「プランB(応相談)」も提供しています。 皆様がAIと歩む未来を創造する一助となれば幸いです。 AI×DX寺子屋の詳細はこちら

SOLIZE PARTNERSが語る、製造業のDXにおけるAI活用のはじめの一歩

2025.10.31

■導入企業の紹介 SOLIZE PARTNERS株式会社(以下SOLIZE PARTNERS)は、日本で初めて3Dプリンターを導入して以来、長年にわたり日本のものづくりを支えているデジタルエンジニアリングのパイオニアです。昨今は社内のデジタルトランスフォーメーション(DX)にも取り組まれており、熟練技術のデジタル化による普及やAIを活用した新しいソリューション開発に注力されています。このたび、株式会社EQUESは、SOLIZE PARTNERSのAI技術導入による課題解決を支援するため、AI PoC(概念実証)サービス『ココロミ』を提供いたしました。導入から運用までの様子をインタビューさせていただきましたので、AI技術導入をお考えの方はぜひご一読ください。 ■SOLIZE PARTNERSの課題 SOLIZE PARTNERSがAI技術の導入において抱えていた課題は、「熟練技術者の頭の中にある情報をどうやってシステム化するか」というものでした。 AIによるDXを進めるにあたって、これまで熟練者が経験によって培ってきた感覚的で言葉にならないノウハウを、いかにAIのシステムに組み込み、活用に漕ぎつけるかという課題は、SOLIZE PARTNERSに限らずものづくり業界全体のDXにおける大きなボトルネックとなっています。 AI導入のプロジェクトを始めるにあたって、この課題を解決するべく、PoC(概念実証)からその分析、アクションプランの策定までを包括的に行う弊社サービス「ココロミ」が導入されました。 ■導入の経緯 「熟練技術者の頭の中にある情報をどうやってシステム化するか」という課題の中で、AIを活用する目的として立ち上がったのが「複数視点からの画像入力を用いた部品特徴の網羅的な検出」というテーマでした。 このテーマを軸に、SOLIZE PARTNERSとEQUESの共同検討がスタートしました。 ココロミを導入する決め手は、弊社が3D生成に関する豊富な経験を有していたことでした。例えば、株式会社セガ様との事業においては、ユーザが簡単なキーワード入力を行うだけでボクセル形式の3Dモンスターを生成するAIを開発した実績があります。(詳しくはこちら)。この開発をSOLIZE PARTNERSに認知していただいたことがご縁となり、共同開発が実現しました。 ■導入後の成果 ココロミでは、以下の2つのテーマでPoC(概念実証)を実施し、それぞれに新たな成果を得ることができました。 取り組み1:設計ナレッジの提案支援 最初の取り組みでは、特定の形状データから特徴を抽出し、それをもとに設計ナレッジを自動で提案するAIの実現性を検証しました。その結果、開発現場で直接活用できるレベルの設計知識をAIが提示できることを確認。従来のように過去資料や文献を検索する手間をかけずに、設計のヒントを得られるようになり、知見の再利用性が大きく高まりました。 取り組み2:3D CADデータの自動生成 次の取り組みでは、自然言語による指示からAIが適切な3D CADデータを生成できるかどうかを検証しました。その結果、単純な形状や構成であればAIによる自動生成が可能であることを確認しました。一方で、複雑な形状を扱う際には、構成部品となる要素データを事前に十分整備しておく必要があることも明らかになり、今後の改善の方向性が見えてきました。これらの検証を通じて得られた成果は、SOLIZE PARTNERSにおけるAI活用を現場レベルへ展開するための第一歩となりました。 ■ココロミ導入を通しての感想 ココロミの推進において、EQUESの徹底した伴走が大きな安心感につながったとのお言葉をいただきました。開発中、多くの技術的懸念や疑問に対し、担当PMエンジニアが都度、論理的な裏付けをもって丁寧に説明させていただきました。技術的な不確実性のあるテーマであったからこそ、一貫した伴走と安心感が、『ココロミ』の提供価値を高め、開発を成功に導くための心の支えとなったと評価いただいています。 さらに、AIという新しい技術への挑戦は、社内への新しい風となり、社員の意識を新たにする理由に繋がりました。 単なる技術検証に留まらず、AI活用に対する社内全体の意識を変革するという、文化的な成果も生まれました。 ■今後の展望 今回の『ココロミ』を通じて得られた知見と信頼関係を基に、SOLIZE PARTNERSはAI技術の応用をさらに深化させていく意向を示されています。 SOLIZE PARTNERS側の担当者様は、「ぜひ次の取り組みをやりたい」と力強く語り、自社の取り組みを継続していく決意を表明されました。 そして、今後の重要なテーマの一つとして、XAIの必要性が挙げられました。 (XAIとは…「説明可能なAI(Explainable AI)」の略。AI、特にディープラーニングは、なぜその結論に至ったのかという判断プロセスが複雑で、人間には理解しにくい「ブラックボックス」状態になることがある。XAIは、このブラックボックスの中身に説明を与え、AIの判断根拠や理由を人間が理解できる形で示すための技術やその研究分野を指す。AIの信頼性と透明性を高め、医療や金融、自動運転など、高い安全性が求められる分野で公正に活用されることを目指している。) SOLIZE PARTNERS側の担当者様は、「ブラックボックスになってしまいがちなAIの判断に説明の有無があることで、現場での意思決定に使えるかどうかは大きく変わる」と、実務における説明責任の重要性を強調されました。 株式会社EQUESは、『ココロミ』を通じて培われた具体的な知見と技術的な基盤をもとに、SOLIZE PARTNERSの新たな価値創造と産業の高度化を引き続き力強く支援してまいります。 SOLIZE PARTNERS HPにて、弊社CEO岸および本プロジェクトPMの村山のインタビューが掲載されております。詳しくはこちらからご覧ください。

AI-OCRで製造現場の記録を自動化|Cyto-Factoの導入事例

2025.10.23

―導入した会社の紹介 Cyto-Facto(サイトファクト)は、神戸に拠点を置く細胞・遺伝子治療分野に特化したCDMO企業です。FBRIの細胞治療研究開発センターを継承し、PIC/S GMP準拠の製造体制を整備。開発から製造、品質試験まで一貫支援し、独自のシステムによるDX推進で、安全かつ高品質な先端治療の社会実装を目指しています。 ― 今回のプロジェクトを始められた背景について教えてください。 製造現場では、通信機能のない機器が多く残っており、液晶パネルや制御PCの画面に表示される情報を作業員が手作業で記録していました。従来のOCR技術では操作が難しい上、読み取り精度も不安定で、業務効率化には限界があったのです。そこで私たちは、AI-OCR技術を活用し、画像認識とデータ抽出の精度向上を目指すプロジェクトを立ち上げました。 ― 具体的にはどのような取り組みをされたのでしょうか? まず、液晶パネルや制御PC画面から取得した画像データをAI-OCRで読み取り、MESやLIMSへ自動入力する仕組みを検討しました。さらに、UIモック版やクラウド版のOCRシステムを開発し、音声入力によるデータ修正機能(日本語・英語対応)も実装しています。また、GMP/GCTP規制を考慮したインターフェース設計にも取り組みました。 ― 開発パートナーにEQUESを選ばれた理由は何ですか? EQUES様は高精度AI-OCR技術の開発実績を持ち、医療や製造分野でのGMP対応経験が豊富でした。また、オフライン環境でのOCR対応力やMES/LIMSとの連携を見据えた提案力・技術力も魅力的でした。複数の課題に対し具体的な解決策を提示していただいたことも大きな決め手です。 ― これまでにどのような成果が得られていますか? UIモック版OCRの社内動作を確認済みで、音声入力によるデータ修正機能のデモも実施しました(日本語・英語対応)。さらに、GPTモデルを活用したクラウド版OCRの開発も進行中です。サンプル画像では100%の認識精度を達成しており、GMP対応を見据えた修正履歴管理機能の設計にも着手しています。 ― 現場からの反応はいかがでしょうか? 「計画通りに開発が進んでいる」「進捗共有がタイムリーで非常にスムーズ」「本開発に向けた準備が円滑に進んだ」といった声が多く寄せられています。現場にとっても大きな期待感につながっていると感じています。 ― 今後の展望を教えてください。 今後は、GMP/GCTP対応を含めたインターフェース設計の詳細化を進めていきます。さらに、iOSやAndroidに対応したアプリの開発や、動画・動的テロップの認識といった新たな機能拡張にも取り組んでいく予定です。

Member

東京大学大学院.ex 松尾研プロジェクトマネジャー.

松尾研起業クエスト1期生.

松尾研チーフAIエンジニアとして企業との共同研究に従事.その後,現実世界と情報学の融合を志し,計数工学科在学時にEQUESを創業.専門はシステム情報学,特にテラヘルツ波通信とハプティクス(触覚技術).

東京大学大学院. ex 松尾研プロジェクトマネジャー

松尾研起業クエスト2期生.産総研「覚醒」事業採択.

AIビジネスコンテスト全国優勝後,計数工学科で現CEO岸と出会いEQUESを創業.

専門は数理情報学であり,クラスタリング最適化や医療AI分野の研究でトップジャーナルや国際会議に採択されている.

Advisor

松尾 豊

技術顧問

2007年より,東京大学大学院工学系研究科准教授. 2019年より教授. 専門分野は,人工知能,深層学習,ウェブマイニング. 人工知能学会からは論文賞(2002年),創立20周年記念事業賞(2006年),現場イノベーション賞(2011年),功労賞(2013年)の各賞を受賞. 2020-2022年,人工知能学会,情報処理学会理事. 2017年より日本ディープラーニング協会理事長. 2019年よりソフトバンクグループ社外取締役. 2021年より新しい資本主義実現会議 有識者構成員. 2023年よりAI戦略会議座長.

Column

【製薬工場向け】医薬品工場の監査対策!GMP要件と指摘事例

2026.05.07

製薬工場や医薬品工場で品質保証(QA)を担当されるマネージャーの皆様、毎回の監査や査察で複数の指摘事項が発生し、その対応に追われていませんか。特に、逸脱や変更管理、CAPA(是正措置・予防措置)の文書作成とレビューは業務のボトルネックになりやすく、特定の担当者に業務が偏る「属人化」が課題となっています。 本記事では、工場の特徴やGMP要件の基本、製造工程の重要ポイント、監査で指摘されやすい領域とその根本原因から、具体的な準備や教育対策までを網羅的に解説いたします。法的要件や品質管理の原則、そして実際の指摘事例に基づいた対策を知ることで、実務に即した業務改善が可能です。 この記事をお読みいただくことで、日々の業務を効率化し、監査の指摘を根本から削減する手順を把握できます。確実な品質保証体制の構築に向け、ぜひお役立てください。 製薬DXの無料相談はこちらから 1. 製薬会社の工場の特徴と求められる要件 製薬会社の工場は、人命に関わる医薬品を製造するため、一般的な工場と比べて極めて厳格な基準のもとで設計および運用されます。 製薬工場の主な特徴と汎用性の高い生産設備 多種多様な医薬品を製造するため、製薬工場の生産設備は汎用性が高く設計されています。複数の医薬品を生産できる兼用ラインを設けることで、多品種・少量生産や需要変動に対応しています。 製薬工場に求められる法的要件(施設・環境) 製薬工場を安全かつ適法に稼働させるためには、製造に関するルールだけでなく、施設や環境に関する多岐にわたる法令の遵守が不可欠です。以下は、遵守すべき法令の一部です。 工場立地法・建築基準法:一定規模以上の製薬工場を新設・増設する際の事前の届出義務や、建物の安全基準を満たす設計が求められます。 消防法:火災の予防や災害時の傷病者搬送を適切に行うため、防火管理者の配置や消防計画の作成・届出が厳格に定められています。 廃棄物処理法:製造過程で生じた廃棄物や廃液は、法令で規定された処理方法に従い、適正に管理・廃棄しなければなりません。 容器包装リサイクル法:医薬品の販売に容器や包装を利用する事業者や、容器の製造・輸入を行う事業者は「特定事業者」に該当するため、再商品化(リサイクル)の義務を果たす必要があります。 GMP省令(施設面):外部からの虫の侵入や製品への異物混入を防ぐため、窓やドアへの防虫フィルムの貼付や、建物の気密性を高める対策が必要です。温度や湿度の厳密なモニタリングも求められます。 2. 医薬品の製造工程の重要なポイントと品質保証 医薬品の品質を確保するためには、製造から出荷、流通に至るまでの全工程で厳格な管理が必要です。 製造工程の3つのステップとGDPガイドライン 医薬品の製造は、有効成分を合成・精製する「原薬製造工程」、原薬を錠剤やカプセルなどに加工する「製剤工程」、品質を保持するために密閉する「包装工程」の3つのステップで行われます。工場から出荷された後も、安全に医療機関や患者へ届けるために、「GDP(医薬品の適正流通基準)」ガイドラインに則った厳密な温度管理や流通記録の保持が不可欠です。 品質を担保するバリデーションの重要性 製造手順や使用する設備が期待通りに機能し、一定の品質の製品を恒常的に製造できることを科学的に検証し、文書化する作業を「バリデーション」と呼びます。 特に、製造工程全体が適切であることを証明する「プロセスバリデーション」は、監査においても重点的に確認される項目です。プロセスの妥当性を継続的に評価することで、品質不良のリスクを未然に防ぎます。プロセスバリデーションの詳細については、別の記事で解説しておりますので、そちらの記事もご確認ください。 3. 監査で指摘が出やすい領域とその根本原因 公的機関による監査や査察では、品質保証システムの根幹に関わる部分に指摘が集中します。 逸脱・変更・CAPA管理における深刻な不備 製造手順から外れた事象(逸脱)の管理や、それに対する是正措置・予防措置(CAPA)が不十分であるケースは、重大な指摘につながります。日々の業務に追われて原因調査やCAPA報告書の作成が遅延し、提出された文書のレビューに時間がかかることで、承認プロセスの遅れが発生することが根本原因として挙げられます。 QA業務の過度な属人化とヒューマンエラー QAに関する文書の作成や確認が、特定の熟練担当者の経験や記憶に依存している「属人化」も製薬工場の大きな課題です。担当者の不在時や業務の集中時にチェック体制が機能しなくなり、数値の入力ミスや記載漏れといったヒューマンエラーが引き起こされます。 4. 監査・査察への準備と当日の運び 監査の指摘を削減するには、事前の準備と当日のスムーズな対応手順を確立することが重要です。 監査対策チェックリストと模擬査察の実施 事前にGMPやGQPなどの要件に基づいた詳細なチェックリストを作成し、定期的な自己点検を実施します。過去の指摘事項や他社の事例を組み込み、基準の抜け漏れがないかを確認します。実務において確認すべき具体的なチェック項目例は以下の通りです。 【実務用】監査前自己点検チェックリスト 1. 文書および記録の管理 現場に最新のSOP(標準作業手順書)が配備され、旧版は確実に回収されているか 製造記録や試験検査記録に記入漏れや、規定外の訂正(修正液の使用など)がないか 電子記録に対するアクセス権限が適切に管理され、監査証跡(オーディットトレイル)が機能しているか 2. 逸脱・CAPA(是正措置・予防措置) 発生したすべての逸脱について、定められた期限内に原因調査が完了しているか 立案されたCAPAの進捗が管理され、期限超過の案件が放置されていないか 実施したCAPAに対する有効性評価(再発防止の確認)が記録されているか 3. 構造設備と環境モニタリング 製造設備および試験機器の定期的な校正(キャリブレーション)が計画通りに完了しているか 温湿度、差圧、微粒子数などの環境モニタリングデータが継続的に記録され、規格外の値に対する措置が取られているか 4. 人材教育と訓練記録 全作業員に対する定期的なGMP教育が実施され、受講記録が保管されているか 新規導入された設備や改訂された手順について、作業前の教育訓練が実施されているか 当日の運びとしては、このリストに基づく模擬査察を実施し、査察官からの質問に対して現場担当者が事実に基づいて回答し、根拠となる記録を即座に提示できる体制を整えておくことが有効です。 品質向上のための工学的アプローチ(IE・SQC)の活用 製造工程の効率化と品質向上のためには、勘や経験に頼らない科学的なアプローチを取り入れることが有効です。ここでは代表的な2つの手法をご紹介します。 IE(インダストリアル・エンジニアリング:生産工学) 作業員が無理なく、間違いなく作業できる「仕組み」を作るための手法です。具体的には、作業員の動線に合わせて設備の配置(レイアウト)を改善したり、作業手順を細かく分析してムダな動きを省いたりします。これにより、誰が作業しても同じ結果を出せるように手順を「標準化」でき、ヒューマンエラーを防ぐ環境が整います。 SQC(統計的品質管理) 製造過程の数値を集め、データを用いて品質を管理する手法です。たとえば、製造中の温度や圧力といったデータを常にグラフ(管理図)にして監視します。これにより、「不良品が出る前に、いつもと違う僅かな変化(異常の兆候)にいち早く気づく」ことが可能になります。 これらの手法を活用することで、手順の標準化とデータに基づく確実な管理が両立し、監査で指摘されにくい強固な品質保証体制を事前に構築することができます。 5. 人材教育・ヒューマンエラー対策の徹底 ヒューマンエラーを根本から防ぐためには、従業員に対する均一な教育が必須です。 教育資料のひな形と実務テンプレートの活用 短時間の動画学習コンテンツや、実務に即した教育資料のひな形を活用することで、指導者の作成負担を軽減しつつ教育の質を保ちます。 弊社EQUESの学習サービス『AI×DX寺子屋 learning』では、製薬業界の品質保証に特化した1回約10分の動画コンテンツや確認テストを提供しています。また、実務用プロンプトテンプレートを活用することで、担当者の経験に依存せず、正確な文書を作成できます。 AI×DX寺子屋Learningのお問い合わせはこちらから 6. 事例:QA文書DXで監査指摘ゼロへ QA部門の業務負担を軽減し、属人化を解消するためには、AIを活用したDXの推進が具体的な解決策となります。 製薬SaaS「QAI Generator」の導入効果 東京大学松尾研究所発のAIベンチャーである弊社(株式会社EQUES)は、製薬業界の品質保証業務に特化したSaaS「QAI Generator」を提供しています。画面上の質問に回答するだけで、AIが逸脱やCAPAに必要な書類を自動作成します。 実際に導入いただいた企業様では、文書の作成時間を5割削減し、レビュー時間を7割以上短縮する結果を得ています。本サービスは、経済産業省・NEDOが主導する国内生成AI開発力強化プロジェクト「GENIAC」にも採択されています。 QAI Generator公式サイトはこちらから 導入ステップと費用感・ROI 導入に際しては、まず現状の課題をヒアリングし、貴社の業務フローに合わせたプランを提案いたします。文書作成およびレビューの時間が短縮されることで残業代が削減され、本来の品質保証業務へリソースを投下できるため、高い投資対効果(ROI)が見込めます。 さらに、複数のQA文書間の齟齬をAIが自動検出する「QAI Checker」と併用いただくことで、監査指摘ゼロを目指す確実な対策を実現できます。 QAI Checker公式サイトはこちらから 7. まとめ 本記事では、製薬工場および医薬品工場における監査・査察対策について、法規制・GMP要件から、業務の属人化解消までを解説いたしました。 本記事の要約は以下の通りです。 工場の施設・環境要件を満たし、製造3ステップとGDPに則った管理を徹底することが重要。 逸脱やCAPA管理における文書作成の遅れと、業務の属人化が監査指摘の主な根本原因。 事前のチェックリストやIE・SQCの活用、ひな形を用いた人材教育でヒューマンエラーを防ぐ。 弊社のAIサービス「QAI Generator」の導入により、文書作成とレビューの時間を大幅に削減し、ROIを向上させることが可能。 監査のたびに指摘対応に追われる状況を改善するためには、文書作成業務のDX化が不可欠です。QA業務の効率化についてご検討の際は、ぜひ弊社(株式会社EQUES)までお問い合わせください。東大出身のAI専門家集団が、貴社の課題解決とAIを活用した技術開発をサポートいたします。 製薬DXの無料相談はこちらから

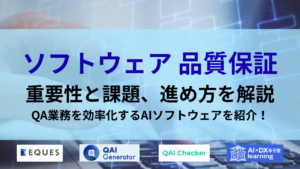

ソフトウェアの品質保証(QA)とは?重要性と課題、進め方を解説

2026.04.28

ソフトウェア開発において、「リリース後の不具合が減らない」「開発サイクルの短期化によりテスト工数が足りない」と悩むプロジェクトマネージャーは少なくありません。システムが高度化する現在、手作業のみで品質を担保することは限界に近づいています。 本記事では、ソフトウェア開発における品質保証(QA)の基礎から具体的な進め方までを体系的に解説します。さらに、人的リソースの不足を補う品質保証ソフトウェア(AIツール)の活用方法も紹介します。 国際的な品質基準(ISO/IEC 25010)や客観的な事実に基づき、実務に直結する情報を整理しました。 この記事を読むことで、社内のプロセスを正しく見直す道筋が明確になり、効率的で確実な品質向上を実現するための具体的な手順を把握できます。 AI導入のお問い合わせはこちら 1. ソフトウェアにおける品質保証(QA)とは? ソフトウェア開発を計画通りに進めるためには、品質保証の定義とその対象領域を正確に理解することが必要です。 品質保証(QA)の定義 ソフトウェアにおける品質保証(Quality Assurance:QA)とは、顧客の要求を満たす製品を提供し、開発過程における不具合の発生を防ぐためのプロセス全般を指します。 ソフトウェアの品質は、単に「バグがない状態」のみを意味するものではありません。ソフトウェアの品質評価の国際規格であるISO/IEC 25010(システム及びソフトウェア品質モデル)においては、 機能適合性(目的通りに動くか) 使用性(使いやすいか) 信頼性(障害に強いか) など、複数の品質特性が定義されています。これらの基準を満たす状態を構築し、維持することがQAの目的です。 GMPにおける統計的な工程管理について詳述した記事はこちらをご覧ください。 QA・QC・テストの違い 開発の現場では、QA、QC(品質管理)、テストという用語が混同される場合があります。それぞれの役割と範囲は以下の通りです。 ・QA(品質保証)の役割 QAは、開発プロセス全体を対象に、エラーや不具合が発生しないための仕組みを構築します。予防的なアプローチにより、長期的な視点で品質を保証します。 ・QC(品質管理)の役割 QC(Quality Control)は、完成したソフトウェアや各工程の成果物が、定められた基準を満たしているかを確認する活動です。発生した問題を発見し、修正することに焦点を当てます。 ・テストの役割 テストは、ソフトウェアを実際に稼働させ、意図した通りに機能するかを確認する作業です。QCの一環として実施され、欠陥を見つけ出すことを直接的な目的としています。 項目対象範囲アプローチ実施タイミングQA(品質保証)開発プロセス全体エラーや不具合を防ぐ仕組みの構築(予防的・長期的)プロセス全体を通して継続的に行うQC(品質管理)完成したソフトウェアや各工程の成果物基準を満たしているかの確認、問題の発見と修正各工程の成果物完成後、またはソフトウェア完成時テスト実際に稼働するソフトウェア意図した通りに機能するかの確認、プログラミング欠陥の発見ソフトウェアが稼働できる状態になった段階(QCの一環) 2. なぜソフトウェア品質保証の観点が重要なのか 品質保証のプロセスを適切に運用することは、企業経営とプロジェクト管理の双方において重要です。 手戻りと修正コストの削減 ソフトウェア開発において、不具合の発見が遅れるほど修正コストは増大します。リリース後に修正を行う場合、要件定義や設計段階で修正する場合と比較して、対応にかかる費用と時間は大幅に増加します。上流工程からQAの視点を取り入れることで、プロジェクト全体の手戻りを抑え、コストの最適化に繋がります。 ユーザー満足度と信頼性の向上 システムの不具合や停止は、ユーザーの利便性を損ない、提供企業のブランド価値を低下させる要因となります。要件定義に基づいた高品質なソフトウェアを安定して提供することは、ユーザー満足度の維持に直結し、市場における競争力を確保するために不可欠です。 3. ソフトウェアの品質保証は誰が行うのか 品質を確保するためには、特定の部門だけでなく、組織全体での連携が求められます。 QAエンジニアと開発チームの連携 品質保証活動は、専任のQAエンジニアや品質保証部門の責任者が主導し、テスト計画や基準を策定することが一般的です。しかし、実際の品質はQA部門のテスト工程だけで担保されるわけではありません。 開発チームによるコーディング規約の遵守や単体テストの確実な実施、プロジェクトマネージャーによる品質目標に沿った進行管理など、関係者全員の協力が不可欠です。開発の初期段階から品質に対する共通認識を持つ「全員参加型の品質保証」体制を築くことが理想的です。 4. 現代のソフトウェア開発が抱える品質保証の課題 品質保証の必要性が認識されている一方で、その実行において多くの企業が課題を抱えています。 開発の短期化とQA人材の不足 アジャイル開発(「計画→設計→実装→テスト」の細かいサイクルでの“素早い”開発)の普及により、ソフトウェアのリリースサイクルは短期化しています。これにより、テスト工程に十分な時間を割り当てることが難しくなっています。さらに、専門的な知識を持つQAエンジニアは不足傾向にあり、社内リソースのみで体制を維持することが困難なケースが増加しています。 システムの複雑化と手動テストの対応困難 API連携、マルチデバイス対応、クラウドインフラの利用等により、ソフトウェアの構造は複雑化しています。さらに、確認すべきテストパターンや、セキュリティ・パフォーマンスなどの非機能要件の検証項目は増加の一途を辿っています。このような複雑化が進む中、手動のみでテストを実施する場合、確認の抜け漏れやヒューマンエラーの発生確率が高まります。 5. ソフトウェアの品質保証の進め方 上記のような課題に対応し、確実な品質保証の仕組みを構築するための手順を解説いたします。 ・1. 要件定義と品質計画の策定 まずは、要件定義の段階でユーザーがソフトウェアに求める要件を正確に把握し、品質の目標を設定します。目標が定まった後、それを達成するための基準、テスト手法、スケジュール、人員配置などを記載した「品質計画書」を策定します。 ・2. テスト設計と不具合トラッキングの実行 品質計画に基づき、テストケースを設計します。正常な操作に加えて、例外的な操作が行われた際の挙動(異常系)を含めたテストシナリオを作成します。テスト実行後は、発見されたバグを記録・管理する不具合トラッキングを行い、修正と再確認のプロセスをシステム的に管理します。 ・3. テスト自動化によるカバレッジの向上 複雑なシステムにおいて手作業による検証には限界があるため、テスト自動化ツールの導入が効果的です。回帰テスト(リグレッションテスト)などを自動化することで、人的リソースを節約しつつテストカバレッジ(網羅率)を向上させ、安定した品質管理を実現します。 6. AIを活用したソフトウェア品質保証の最適化とおすすめツール 人的リソースの制約やテスト工数の不足といった課題を解決するためには、AIを活用したソフトウェアやSaaSを導入し、品質保証業務自体を効率化することが有効です。 GMP逸脱管理におけるAI活用の可能性について解説した記事はこちらからご覧ください。 AIソフトウェアによるQA業務の効率化 ドキュメントの整合性確認やテストパターンの設計などにAIソフトウェアを活用することで、目視確認によるヒューマンエラーを削減できます。これにより、QA担当者はテストの実行業務から解放され、より上流の品質計画や要件定義の改善に注力することが可能になります。 株式会社EQUESのQA支援ソフトウェア(SaaS)とサービス 東大松尾研究所発のスタートアップである株式会社EQUESは、AIを用いた「伴走型技術開発」により、企業のソフトウェア開発や品質マネジメントの課題解決を支援しております。製薬分野など厳格な品質管理が求められる業界での実績をもとに、以下のサービスを提供しています。 QA業務を効率化するAIソフトウェア群 実務の課題を解決するため、以下のSaaSプロダクトを展開しております。 製薬SaaS QAI Generator: 簡単な質問に答えるだけで、品質保証(QA)に関わるGMP文書をAIが自動作成します。文書作成時間を5割削減、レビュー時間を7割以上短縮する実績があり、経済産業省の「GENIAC」事業にも採択されました。 QAI Generatorの詳細はこちら 製薬SaaS QAI Checker: 複数のQA文書を段落ごとに解析し、数値や工程・名称などの齟齬をAIが自動検出するソフトウェアです。目視では見逃しやすいエラーを防ぎ、結果はエクセルで一括ダウンロードが可能です。 QAI Checkerの詳細はこちら AI×DX寺子屋 learning: 製薬業界のQA関連教材をはじめとする業務特化型の学習コンテンツです。1回約10分の動画学習や実務用プロンプトテンプレートを活用し、QA担当者の技術向上を支援します。 AI×DX寺子屋による包括的支援 弊社のAI×DX寺子屋では、東大出身のAI専門家集団がチャットを通じて技術的な課題に対応いたします。 プランA:月額20万円でAI専門家にチャット相談し放題(月1回のオンラインミーティング含む) プランB:大学講義資料の作成や技術者の派遣など、要件に応じた柔軟な支援 開発前のPoCと最先端研究 大規模な開発の前段階として、月々250万円から実施可能なPoC(概念実証)サービスであるココロミを提供しております。また、経済産業省・NEDOの支援を受けた「量子コンピュータを用いた薬剤耐性菌の治療戦略研究」など、最先端の技術研究も行っております。 ご興味をお持ちの方は、ぜひお気軽にお問い合わせください。 AI導入に関するお問い合わせはこちら 7. まとめ 本記事では、ソフトウェア開発における品質保証(QA)について解説いたしました。 QAは開発プロセス全体を対象とし、不具合の発生を予防する活動である 開発の短期化やシステムの複雑化により、手動のみのQAは対応が困難になっている 品質の担保と手戻りコスト削減のためには、要件定義に基づくテスト設計と不具合トラッキングが不可欠である 人的リソース不足の解決には、テスト自動化やAIを活用したQA支援ソフトウェアの導入が有効である ソフトウェアの品質保証プロセスを体系的に理解し、社内の体制を最適化することは、プロジェクトを成功させるための重要な要素です。 自社に最適な品質保証体制の構築や、AIソフトウェアを活用した業務効率化をご検討の際は、株式会社EQUESにお問い合わせください。弊社の専門家チームが貴社の現状を分析し、品質向上に向けた具体的な支援策をご提案いたします。 AI導入のお問い合わせはこちら

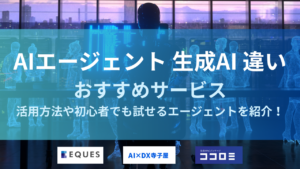

AIエージェントと生成AIの違い・おすすめサービスと始め方【詳細解説】

2026.04.28

自社の業務効率化に向けてAIの導入を検討する中で、「生成AIとAIエージェントの違いがわからない」「どのAIエージェントサービスを選べばよいのか迷っている」といった課題をお持ちではないでしょうか。 本記事では、AIエージェントの基本的な仕組みや生成AIとの違いを明確にし、ビジネス現場で役立つおすすめのAIエージェントサービスをご紹介します。弊社、株式会社EQUESのAI専門家としての知見をもとに、非エンジニアの担当者様にも理解しやすい言葉で解説します。 本記事をお読みいただくことで、自社の業務課題に適したツールの選び方と、小さく始めるためのPoC(概念実証)の手順が明確になり、組織のAI活用を具体的に前に進めることができます。 AIに関する無料相談はこちらから 1. AIエージェントとは?生成AIとの明確な違い AIエージェントの基本概念 AIエージェントとは、ユーザーから与えられた目標を達成するために、自律的に思考し、計画を立て、一連の行動を実行するAIシステムを指します。単に質問に対してテキストを返すだけでなく、必要な情報を自ら検索し、外部のツールやアプリケーションを操作し、複数のステップを経てタスクを完遂する能力を持っています。人間が細かく指示を出さなくても、AI自身が「次にするべきこと」を判断して動くのが特徴です。 AIエージェントと生成AIの役割の違い AIエージェントと生成AIの主な違いは、「自律性」と「行動力」にあります。 生成AI(Generative AI)は、ユーザーの入力(プロンプト)に対してテキスト、画像、音声などを生成するツールであり、人間の指示に対して単発の応答を行うことを基本としています。 一方、AIエージェントは、この生成AIを「頭脳」として組み込みつつ、自らタスクを細分化し、実行に移す能動的なシステムです。たとえば、「来月の出張の手配をして」と指示した場合、生成AIは「手配の一般的な手順」をテキストで出力します。しかしAIエージェントは、日程に基づいて実際にフライトやホテルを検索し、最適な予約プランの提案やシステムへの入力までを代行します。(※2026年現在、生成AIの日々アップデートにより、生成AIとエージェントの境界は曖昧になりつつあります。Geminiの「Gem機能」ように、一部エージェント的機能を備えた生成AIサービスも登場しています。) 導入プロセスの違い 導入方法にも大きな違いがあります。生成AIは、既存のチャットサービスなどを利用することで比較的容易に導入でき、すぐに使い始めることが可能です。対してAIエージェントは、業務プロセスの中に組み込まれて継続的に動作することを前提とするため、事前のシステム設計やデータ連携などの準備が必要となります。 比較項目生成AI (Generative AI)AIエージェント (AI Agent)定義ユーザーの指示(プロンプト)に応じて、テキストや画像を生成するツール目標達成のために自ら考え、計画を立て、外部ツールを操作して実行するシステム動作の性質受動的:指示されたことに対して回答を返す自律的:入力された目標に向けて「次は何をすべきか」を自ら判断して動く得意なこと文章の作成、要約、翻訳、アイデア出しなど複雑なタスクの分解、外部アプリの操作、一連の業務プロセスの完遂実行の主体人間が細かく指示を出し、結果を確認するAIが自らツールを使い分け、複数のステップを自動で進行導入の難易度チャット形式ですぐに使い始めることができ、導入は容易業務プロセスへの組み込みやシステム連携が必要なため、事前準備が必要 2. AIエージェントサービスの種類と主な活用シーン AIエージェントサービスには、目的や利用シーンに応じていくつかの種類があります。ここでは代表的な分類と、それぞれの活用シーンを解説します。 タスク自動化型:社内業務の効率化 反復的な業務を自動化することに特化したタイプです。データ入力、定型メールの送信、レポートの作成といった作業を自動化します。従来のRPA(ロボティック・プロセス・オートメーション)と似ていますが、AIエージェントは自然言語の指示を理解し、予期せぬ変更にも柔軟に対応できる点が優れています。 情報検索・要約型:高度なデータ分析 膨大なデータから必要な知識を抽出し、要点を整理して提示する機能に特化しています。社内データベースやインターネット上の情報を定期的に監視し、特定の市場動向に変化があった場合にアラートを出したり、競合他社のニュースを分析して要約レポートを作成したりすることが可能です。 対話・接客型:顧客サポートと高度な問い合わせ対応 顧客の質問の意図を文脈から汲み取り、社内のマニュアルや過去の対応履歴を自律的に参照して回答を生成するタイプです。複雑な問い合わせに対しては、情報を整理した上で適切な人間の担当者へ引き継ぐ判断も行うため、サポート業務の品質と効率を同時に向上させます。 3. 初心者でも試せるおすすめAIエージェントサービス5選 ここでは、非エンジニアでも扱いやすく、ビジネス現場での導入実績が豊富なAIエージェントサービスをご紹介します。 Dify - LangGenius社(ノーコード・ローコードでの柔軟な開発) Difyは、オープンソースの大規模言語モデル(LLM)アプリケーション開発プラットフォームです。プログラミングの深い知識がなくても、視覚的な操作で独自のAIエージェントを構築できるため、事業部門の担当者様にもおすすめのサービスです。テンプレートを活用することで、短時間で試作を行うことができます。 [参照元: Dify 公式サイト] Coze - Bytedance社(ワークフロー作成と外部連携に強み) Cozeは、直感的な操作でAIエージェントを作成・運用できるプラットフォームです。プラグインなどの豊富なツールを活用して外部システムと柔軟に連携でき、複雑なワークフローを迅速に構築できる点が特徴です。小規模なプロジェクトから検証を始める用途に適しています。 [参照元: Coze 公式サイト] Agentforce - Salesforce社(Salesforce等とのシームレスな連携) Salesforceが提供するAgentforceは、CRM(顧客関係管理)システムとの統合に特化したAIエージェントです。顧客データに基づき、営業支援やカスタマーサポートのプロセスを自律的に実行します。既存のSalesforce環境を活用し、業務用アプリとの連携をスムーズに行いたい企業におすすめです。 [参照元: Salesforce 公式サイト] OpenAI GPTs - OpenAI社(対話型のプロンプトによる手軽な構築) GPTsは、ChatGPTの機能を利用して特定の目的に特化したカスタムAIを作成できるサービスです。自然言語による対話形式で「どのような振る舞いをしてほしいか」を指示するだけでAIエージェントを作成できるため、最も手軽に始められる選択肢の一つです。 [参照元:Introducing GPTs] Microsoft Copilot Studio - Microsoft社(社内システムとの連携) 自社独自のAIエージェントを構築できるエンタープライズ向けのプラットフォームです。Microsoft 365の各種アプリケーション(TeamsやSharePointなど)や社内のデータソースとの連携に優れており、既存の業務環境に自然に溶け込ませることが可能です。 [参照元: Microsoft Copilot Studio 公式サイト] 4. PoC(小さく始める)の手順とツールの選び方 自社に合ったAIエージェントサービスの選び方 AIエージェントサービスを選定する際は、まず「解決したい具体的な課題は何か」を明確にします。その上で、以下の点を確認します。 機能と柔軟性: 自社の業務フローに合わせたカスタマイズが可能か。 運用体制: 非エンジニアである事業部門の担当者でも運用・改善が可能か。 最初は多機能なツールにこだわらず、特定の部署の小さな課題に焦点を当て、必要十分な機能を持つシンプルなツールを選ぶことが成功の鍵となります。 導入時の注意点とセキュリティ対策 AIエージェントは自律的にシステムを操作するため、導入に際しては運用体制の整備とセキュリティ対策への配慮が重要です。社内の機密情報や顧客データへのアクセス権限を適切に管理し、AIの実行プロセスを人間がモニタリングできる状態(ヒューマンインザループ)を維持することで、安全な運用が可能になります。 スモールスタートのためのPoC手順 大規模なシステム導入を行い失敗するリスクを避けるためには、PoC(概念実証)を通じて有効性を検証することが極めて重要です。 目的と指標の設定: どの業務の時間を何割削減するのかなど、具体的な評価基準を設定します。 ツールの選定と試験導入: DifyやCozeなど、初期投資が少なく手軽に試せるサービスを利用します。 プロトタイプの作成と検証: 実際の業務データ(ダミーデータ等)を用いて簡単なAIエージェントを作成し、一部のメンバーでテスト運用を行います。 評価と改善: テスト結果を分析し、本格導入に向けた課題を洗い出します。 AIエージェントの導入・PoCなら株式会社EQUESにお任せください AIエージェントの導入やPoC(概念実証)を確実に成功させるためには、技術的な専門性とビジネス理解の両立が不可欠です。株式会社EQUESでは、東大松尾研発のスタートアップとして、最先端の知見を活かした「伴走型技術開発」を提供しています。 専門家集団による迅速な検証:PoCサービス「ココロミ」 大規模なシステム開発に着手する前に、まずは「ココロミ」によるスピーディな検証を推奨しています。 低リスクな開始: スタンダードプラン月々250万円から、実際の業務における有効性を検証可能です。 高度な技術力: 東大出身のAI専門家が、貴社の課題に最適なAIエージェント サービスの選定やカスタマイズをサポートします。 ココロミ公式HPはこちらから 導入後の運用を支える「AI×DX寺子屋」 ツールを導入して終わりではなく、現場への定着までを支援する体制を整えています。 相談し放題: プランA(月額20万円)では、チャットを通じてAIやDXに関する困りごとをいつでも専門家に相談できます。 業務特化の知見: 特に製薬分野に強みを持ち、GMP文書作成効率化の「QAI Generator」や、書類の齟齬を検出する「QAI Checker」などの実績に基づいたアドバイスが可能です。 自社に最適なAIエージェント 生成AIの活用方法が見つからない、あるいは導入の進め方に不安があるという担当者様は、ぜひ一度弊社へご相談ください。貴社のビジネスに深く寄り添い、確実な成果へと導きます。 AI×DX寺子屋公式HPはこちらから 5. AIエージェント サービスに関するよくある質問 Q1. AIエージェントと生成AI、どちらを先に導入すべきですか? まずは生成AIの活用から始めることをお勧めします。生成AIを通じて「AIで何ができるか」を組織全体で理解した上で、より高度な自律性やシステム連携が必要な業務に対してAIエージェントを導入するのが、失敗の少ない順序です。 Q2. AIエージェント おすすめのツールを選ぶ際の決め手は何ですか? 「自社の既存システム(SlackやTeams、顧客データベース等)と連携できるか」と「現場の担当者が自らメンテナンス可能か」の2点を確認してください。ノーコードで構築できるツールであれば、業務プロセスの変更にも柔軟に対応できます。 Q3. AIエージェント サービスを導入する際のコスト感は? DifyやOpenAI GPTsのように、月額数千円程度の低コストで始められるサービスも増えています。ただし、自社の基幹システムと深く連携させる場合や、高度なセキュリティ要件を満たす構築を行う場合は、専門家による設計が必要となり、別途構築費用が発生します。 月額20万円でAIの専門家に相談し放題の「AI×DX寺子屋」をご検討ください! AIに関する無料相談はこちらから 6. まとめ 本記事では、AIエージェントと生成AIの違い、おすすめのAIエージェントサービス、そして導入に向けたPoCの手順について解説しました。内容をまとめると以下の通りです。 AIエージェントは生成AIを頭脳とし、目標達成に向けて自律的に行動するシステムである。 生成AIは手軽に導入できる一方、AIエージェントは業務プロセスへの組み込みが必要となる。 活用目的によって、タスク自動化型や情報検索・要約型などのサービスを使い分ける。 本格導入の前に、セキュリティ要件を確認し、課題を絞ってPoC(概念実証)から小さく始めることが重要である。 AIエージェントは大幅な業務効率化を実現する強力なツールです。まずは自社の課題を整理し、小さな範囲から検証を始めてみてください。 東大松尾研発のスタートアップである株式会社EQUESでは、企業様のAI導入を「伴走型」で支援しております。大規模開発前に仮説検証を行うPoCサービス「ココロミ」や、月額20万円で東大出身のAI専門家に相談し放題の「AI×DX寺子屋」など、企業様のフェーズに合わせたソリューションを提供しております。特に製薬分野やDX推進におけるAI活用に強みを持っています。AIエージェントの導入やDX戦略に関するお悩みがございましたら、ぜひお気軽に弊社までご相談ください。 AIに関する無料相談はこちらから